Airbus, géant de l’aéronautique s’est intéressé très tôt à l’IA générative. Le groupe s’est rapidement doté d’une structure pour cadrer les usages en interne. Cette structure veille à l’éthique des IA déployées. Elle doit s’assurer de la confiance que les collaborateurs et les clients peuvent accorder à ces IA.

Nasser Guesmia est en charge des projets d’IA générative dans le groupe Airbus. Il a vu l’arrivée de ChatGPT comme du pain bénit. Il avait déjà participé à la mise en place de 2 plateformes d’IA avant l’avènement de ChatGPT et le buzz autour de ChatGPT est venu en quelque sorte légitimer son action. Il avait travaillé à une plateforme interne entièrement déployée sur site dédiée au service client. La deuxième plateforme était un chatbot.

“L’une des premières questions posées par le business portait sur la fiabilité des réponses“

La certitude autour des réponses de l’IA générative est en effet un enjeu clé. « Les utilisateurs nous ont demandé si les réponses générées étaient déterministes. Or ces réponses ne sont pas déterministes » rappelle-t-il. « En manufacturing, les utilisateurs métiers ont besoin de réponses absolument exactes » souligne-t-il.

Une organisation transverse pour traiter la question de la confiance

Pour faire face à ces problématiques, Airbus a créé une nouvelle structure baptisée GenAiR pour Generative AI Responsible ou IA générative responsable. « Cette structure est organisée en plusieurs groupes, avec un volet de veille technologique et une partie consacrée à la gestion des demandes » décrit-il.

“Nous avons été confrontés à un tsunami de demandes, avec de l’ordre de 700 cas d’usage proposés en 2023”

D’autres cas d’usage sont différenciés en fonction de la nature des données concernées. « Airbus est une entreprise très régulée, notamment sur toute la partie Flight Control, mais également, on a aussi toute une dimension par rapport à la sensibilité de la donnée. Enfin, comme toute entreprise, nous devons aussi protéger notre savoir-faire » liste-t-il.

Un mandat accordé par le Top management

Le troisième champ d’action de l’IA générative responsable dans GenAiR porte sur la stratégie d’implémentation des IA et en particulier sur le volet d’IA responsable. « Il s’agit d’une structure transverse, avec un mandat accordé par le top management. Son action est cross-fonctions et cross-divisions » insiste le responsable.

“Avec l’IA, l’idée était de nous préparer à être conformes dès le départ“

Nasser Guesmia est convaincu que l’IA est une démarche transformative pour l’ensemble de l’entreprise et que cette transformation doit être alignée sur les valeurs d’Airbus, à commencer par la non-discrimination, l’ouverture, la transparence et l’engagement auprès des clients.

Réutiliser au maximum des structures existantes chez Airbus

L’autre postulat de base pour GenAiR était de s’appuyer sur les processus et les structures existantes au sein du groupe, comme les process de gouvernance de données déjà en place. La stratégie IA pouvait ainsi appuyer son action sur une communauté de Data Officers et de Data Custodians déjà en place dans l’organisation.

“L’idée était de ne pas réinventer une nouvelle structure, ou un nouveau processus, mais de s’intégrer à l’existant”

Un pilier important de cette approche de l’IA porte sur la supervision humaine des IA pour Nasser Guesmia. Toute décision d’une IA doit être validée par un humain. « Il faut des garants humains pour chaque PoC [Preuve de concept], chaque projet. On ne veut pas déresponsabiliser les personnes. Nous considérons l’IA comme un assistant » précise-t-il sur la philosophie entourant l’IA chez Airbus.

Chaque projet fait l’objet d’un self-assessment, une auto-évaluation, pour identifier si son action est potentiellement interdite, acceptable, ou non. La responsabilité est reportée sur les porteurs de projet. La structure GenAiR n’a pas pour rôle de faire la police dans le « backlog », l’historique des projets. Elle vise à responsabiliser chacun sur l’éthique de son IA. Cette approche est en rupture avec la volonté de centralisation de beaucoup d’entreprises, mais qui s’explique aussi par la taille et la décentralisation des activités du groupe Airbus.

Airbus très prudent sur le déploiement d’IA dans ses produits

Un deuxième aspect de la gestion des IA porte sur leur exposition. Une attention toute particulière est apportée aux cas d’usage qui sont utilisés par les clients de l’avionneur, ou même directement dans ses produits. « Pour l’instant, nous avons quelque peu réfréné les demandes en ce sens » reconnaît le responsable. Il se veut très prudent quant au déploiement d’IA dans les avions eux-mêmes.

“Si le projet n’est pas crédible, on n’y va pas ! Sinon tout le monde veut faire tout et n’importe quoi“

Enfin, les modèles sont soigneusement testés et Airbus s’assure que ceux-ci seront conformes en n’étant ni toxiques, ni surdimensionnés et que l’entraînement de ceux-ci respecte la propriété intellectuelle.

Trouver l’équilibre entre le progrès, l’innovation et la responsabilité

Côté conduite du changement, Airbus privilégie la sensibilisation du personnel. Des formations à l’IA et à son impact ont été intégrées au catalogue d’Airbus et, si celles-ci ne sont pas obligatoires, elles sont fortement recommandées. « On ne fait pas de l’IA pour de l’IA, et on le fait aussi par rapport aux valeurs de notre entreprise. Il faut trouver l’équilibre entre le progrès, l’innovation et la partie responsabilité » résume Nasser Guesmia, GenAI Project Lead d’Airbus. Il a pris la parole le 19 mars à l’occasion de l’événement DIMS qui s’est déroulé à Station F, à Paris et organisé par Innovation Makers Alliance.

Top lectures en ce moment

-

Livraison en 1 heure par Carrefour : une créa publicitaire réalisée avec une IA...

-

IA générative : pourquoi Carrefour privilégie l’approche Top-Down et garde lR...

-

Publicité sur les sites commerciaux : Carrefour et Carmila font appel à JCDecaux

L'IA clé de nos besoins vitaux dans l'eau, l'électricité et le gaz

Marchés de l’eau : l’IA générative arrive dans les réponses aux appels d’offres des collectivités

Saur, spécialiste de la distribution d’eau potable, fait évoluer son processus de réponse aux appels d’offres des collectivités et des industriels en y injectant de l’IA géné…

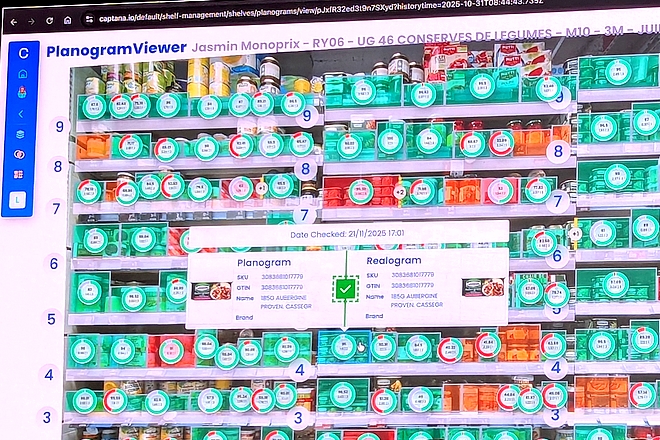

Stockage de l’électricité : l’IA générative outil d’accélération clé chez Engie

Le stockage de l’électricité est un enjeu stratégique. Engie s’y attelle et mobilise pour cela l’IA générative de type RAG, c'est-à-dire basée sur le traçage des documents source. …

Nouvelle donne dans le gaz naturel : GRDF s’adapte en utilisant l’IA

GRDF, leader de la distribution du gaz naturel en France, affine sa stratégie d’IA. Il s’appuie sur des serveurs internes pour la confidentialité des données de ses clients. GRDF c…

Et vous, qu’en pensez-vous ?

Une idée, une réaction, une question ? Laissez-nous un mot ci-dessous.

Je réagis à cet article