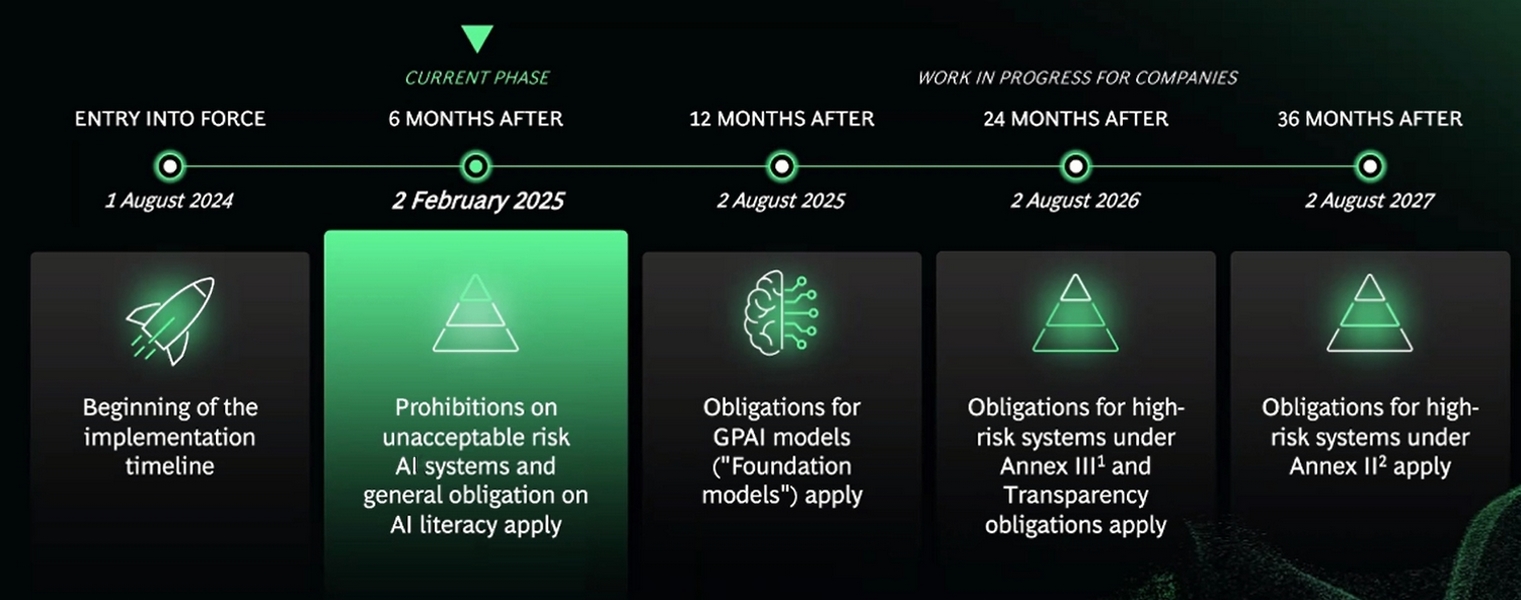

Dimanche 2 février, l’AI Act entre en vigueur en Europe afin d’encadrer les usages de l’intelligence artificielle par les entreprises. Il s’agit d’une première étape qui cible les IA dites « inacceptables » et qui devront être désactivées.

Quatre catégories d’IA selon l’AI Act

Il existe en tout 4 catégories d’IA selon l’AI Act. Les consultants du BCG (Boston Consulting Group) détaillent cette classification à l’occasion d’une Master Class à destination de la presse, le 29 janvier. Le BCG intervient dans la rédaction de propositions sur l’IA auprès de l’Europe et en particulier auprès des chanceliers allemands, Angela Merkel et Olaf Schultz.

Tout d’abord, quel est l’objectif de cet AI Act ? « C’est une loi de protection des consommateurs qui, segmente les cas d’utilisation de l’IA en quatre classifications de risque différentes » présente le BCG.

Il y a tout d’abord les risques inacceptables. Ces cas d’utilisation ne sont plus autorisés dans l’Union européenne à partir de dimanche 2 février, et les entreprises doivent les désactiver.

Des données de haute qualité pour les cas d’usage à haut risque

Puis, il y a les cas d’utilisation à haut risque. Ils tombent sous certaines exigences. Par exemple, on doit s’assurer que les données que l’on met dans ces cas d’utilisation sont de haute qualité afin d’obtenir les meilleurs résultats, par exemple dans le risque de crédit ou que l’on obtienne de bons résultats en ce qui concerne les outils RH, etc.

Il y a ensuite les cas d’utilisation qui ont des risques limités et minimes et qui doivent simplement suivre certaines règles de transparence. Par exemple, lors de la création de contenus vidéo par IA, ceux-ci doivent avoir une étiquette qui les identifie comme créés par l’IA. « Donc, c’est un ensemble d’exigences très complet que la loi européenne donne aux entreprises comme garde-fous. Elles incluent également la possibilité que certains systèmes d’IA soient audités par un tiers et doivent être enregistrés auprès de l’Union européenne » ajoute le BCG.

Stopper les pratiques d’IA qui impactent les droits de l’homme

Dimanche 2 février, les pratiques d’IA interdites devront cesser d’exister dans l’Union européenne. « Celles-ci sont principalement des cas d’utilisation que l’UE a identifiés comme ayant un effet majeur sur les droits de l’homme » explique le BCG.

« C’est par exemple, des techniques manipulatrices ou subliminales provoquant un changement comportemental significatif. Donc, manipuler des adolescents dans certains comportements. Ceux-ci ne sont plus autorisés dans l’Union européenne mais aussi certains cas d’utilisation qui utilisent des techniques de notation sociale comme nous le voyons dans d’autres parties du monde » illustre le BCG.

« L’identification biométrique à distance par les forces de l’ordre, par exemple, dans la recherche et la capture de terroristes, ne sera plus autorisée sauf dans des circonstances spéciales et tout cela devra cesser d’ici dimanche » ajoute le BCG. On trouve peu de ces cas d’usage en entreprise relativise le BCG.

De nombreux cas d’usage d’IA à haut risque

En revanche, le cabinet de consultants identifie beaucoup de systèmes d’IA à haut risque que l’Union européenne veut réguler un peu plus ou veut mettre dans une certaine structure. Ces cas d’usage de l’IA sont présents dans des industries importantes et critiques. « Donc, par exemple, les entreprises d’infrastructures critiques, les entreprises énergétiques, le trafic routier, l’approvisionnement en eau, le gaz, l’électricité. Et aussi certains outils d’éducation et de formation professionnelle » illustre le BCG.

« Ce n’est pas qu’ils doivent cesser d’exister, mais ils ont maintenant des normes et des exigences beaucoup plus strictes autour d’eux pour les rendre plus équitables » précise le BCG. A noter qu’il y a un élément qui n’apparaît pas dans la réglementation mais qui est très intéressant pour les entreprises, ce sont les normes que la Commission européenne proposera pour l’IA. « Qu’est-ce que cela signifie réellement qu’une IA soit biaisée, explicable, transparente ? Cela doit être des indicateurs clés de performance mesurables d’ici la fin de l’année » souligne le BCG.

Enfin, le cabinet conseil insiste sur le fait que tout cela ne doit pas être laissé au seul département juridique. « La loi sur l’IA force un travail beaucoup plus interdisciplinaire de nombreux départements de l’entreprise pour comprendre et vraiment donner vie à ces lois » souligne le BCG. De fait, cette première étape de l’AI Act inclut la nécessité pour les entreprises de former leurs employés à l’IA.